发布时间:2026年4月10日

一、开篇引入

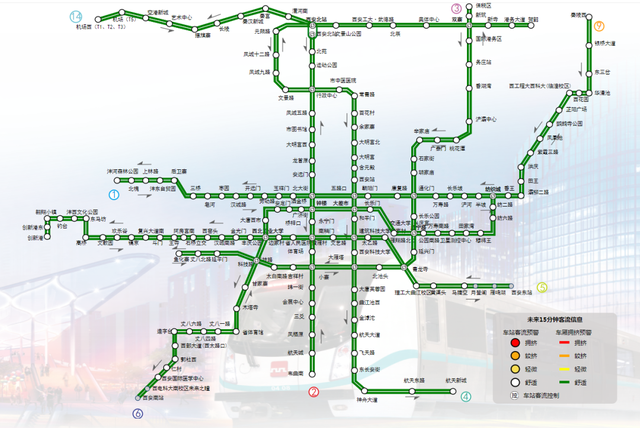

2025年12月29日,西安地铁15号线一期正式开通运营,标志着西安轨道交通第三期建设规划圆满收官,全市地铁运营里程达422公里-2-5。伴随着这条线路的开通,西安地铁AI助手(官方名称为“基于大模型的人工智能客服智能体系统”)同步投运,成为行业首个基于大模型的AI客服智能体系统的落地案例-2。

对于技术学习者来说,AI客服智能体是一个极具代表性的实战案例——它融合了大语言模型(Large Language Model, LLM)、检索增强生成(Retrieval-Augmented Generation, RAG)、语音识别、知识图谱等多项前沿技术,将传统客服的“菜单式”交互升级为“对话式”服务。很多学习者在接触这类系统时会遇到一个共同的困惑:只知道“用大模型”,却不清楚大模型到底怎么落地;RAG和知识库是什么关系也容易混淆;面试时被问到“AI客服系统的技术架构”又答不出关键点。

本文将从问题出发,系统讲解西安地铁AI助手的核心技术架构:先剖析传统客服系统的痛点,再深入解析大模型与RAG两大核心概念及其关联,通过代码示例展示交互流程,最后梳理底层原理与高频面试要点。如果你是AI应用开发方向的学习者、面试备考者或相关技术栈的工程师,本文将帮助你建立完整的知识链路。

二、痛点切入:为什么需要AI智能客服?

在传统地铁客服模式下,乘客遇到问题需要前往客服中心或票亭向工作人员咨询。这个流程的核心代码逻辑可以用一个简化模型来表示:

传统客服系统:菜单式交互 class TraditionalTicketSystem: def show_menu(self): print("请选择业务类型:") print("1. 票卡充值") print("2. 路线查询") print("3. 票价查询") print("0. 人工服务") def handle_input(self, choice): if choice == 1: return self.charge_card_flow() elif choice == 2: return self.route_query_flow() elif choice == 3: return self.price_query_flow() else: return "请前往人工客服台"

这种模式的缺陷非常明显:

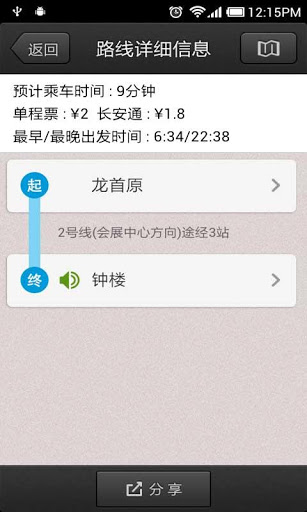

交互方式僵化:用户只能按预设的菜单路径操作,无法用自然语言表达复杂问题(如“我带着两个小孩,需要无障碍通道的路线怎么走”)。

知识更新滞后:线路调整、票价变更等信息需要人工同步更新到多个终端,经常出现信息不一致。

人力成本高昂:每个票亭需要专人值守,高峰期排队严重。

场景覆盖有限:传统系统难以处理开放性问题,如周边信息查询、实时天气查询等。

正是在这样的背景下,西安地铁AI助手应运而生,目标是将97%以上传统票亭业务实现自动化,让乘客用自然语言对话即可完成所有票务操作和出行咨询-1。

三、核心概念讲解:大语言模型

3.1 标准定义

大语言模型(Large Language Model, LLM) 是一种基于海量文本数据训练的深度学习模型,能够理解和生成自然语言。其核心能力在于:给定上文,模型能够预测并生成合理的下文内容。

3.2 关键要素拆解

“大”的含义:一方面指参数量巨大(通常数十亿到数万亿),另一方面指训练数据量庞大(TB级别)。

“语言模型”的本质:学习语言的统计规律和语义关系,而非简单记忆。

核心能力:文本理解、文本生成、推理能力、上下文学习。

3.3 生活化类比

可以把大模型想象成一个读过全世界图书馆所有书籍的超级学霸:你问他任何问题,他都能根据自己的“阅读积累”给出回答。但他有一个弱点——他的知识截止于他“读完书”的那一刻。如果他“读书”的时间是2024年,那么2025年新开通的地铁线路信息他就不了解。这正是为什么我们需要RAG技术来弥补。

3.4 在西安地铁AI助手中的作用

在西安地铁AI助手中,大模型承担了理解乘客意图和生成自然回复的核心任务。当乘客用语音或文字问出复杂问题时,大模型负责解析语义、拆解意图,并组织成通俗易懂的回复。

四、关联概念讲解:RAG

4.1 标准定义

检索增强生成(Retrieval-Augmented Generation, RAG) 是一种结合信息检索与生成式模型的技术架构。其工作流程是:先根据用户问题从知识库中检索相关文档片段,再将检索结果作为上下文输入到大模型中进行回答生成。

4.2 RAG vs 大模型的关系

| 维度 | 纯大模型 | RAG增强的大模型 |

|---|---|---|

| 知识来源 | 仅限训练数据中的知识 | 实时检索外部知识库 |

| 时效性 | 受限于训练数据时间 | 可实时更新知识库 |

| 幻觉风险 | 较高,可能编造不存在信息 | 较低,回答有检索结果支撑 |

| 专用领域适配 | 需要微调 | 只需更新知识库 |

| 运行成本 | 推理成本固定 | 额外增加检索成本 |

4.3 简单示例说明

假设乘客问:“西安地铁15号线从细柳站到东兆余站需要多长时间?”

纯大模型模式:如果大模型的训练数据中不包含15号线信息,可能会编造一个答案,或者回答“我不知道”。

RAG模式:系统先从知识库中检索到“15号线一期全长19.4公里,全程运行时间约30分钟”的信息,然后将这个信息连同用户问题一起输入大模型,大模型据此生成准确回答-17。

西安地铁AI助手正是采用大模型+RAG的方式运行,能够精准响应票价查询、首末班车查询、乘车路线规划、周边信息检索等地铁出行全场景咨询需求-1。

五、概念关系总结

一句话概括两者的关系:大模型是“大脑”,RAG是“引擎”。

大模型负责“想”——理解用户意图、组织语言、生成回答;RAG负责“找”——从知识库中检索最新、最准确的信息供大模型参考。二者配合,既发挥了大模型的语义理解与生成能力,又弥补了纯大模型在时效性和准确性上的不足。

对于开发者来说,理解这一点非常重要:不要把RAG和大模型混为一谈,也不要认为大模型可以独立解决所有问题。在实际工程中,知识库的构建、检索算法的优化往往比模型本身更影响最终效果。

六、代码/流程示例:AI客服对话的完整流程

下面通过一个简化但完整的代码示例,展示乘客与西安地铁AI助手的交互流程:

简化版AI客服智能体核心流程 import requests class MetroAIAgent: def __init__(self): 知识库(可包含时刻表、票价、站点信息等) self.knowledge_base = { "15号线": {"首班车": "06:00", "末班车": "23:00", "里程": "19.4km"}, "票价规则": {"起步价": "2元", "每增加4公里加1元"} } 步骤1:意图识别 + 实体抽取 def extract_intent_and_entities(self, user_query): 实际生产环境使用NER模型 intent = "query_schedule" 意图:查询时刻表 entities = {"line": "15号线"} 实体:线路名称 return intent, entities 步骤2:RAG检索(从知识库中检索相关信息) def retrieve_context(self, intent, entities): query_key = f"{entities.get('line', '')}" context = self.knowledge_base.get(query_key, {}) return context 步骤3:构造Prompt + 大模型生成回复 def generate_response(self, user_query, context): prompt = f""" 你是西安地铁AI客服助手。请根据以下参考信息回答用户问题。 参考信息:{context} 用户问题:{user_query} 要求: 1. 回答要准确、简洁 2. 仅基于提供的参考信息回答 """ 实际调用大模型API response = f"根据查询,15号线首班车为{context['首班车']},末班车为{context['末班车']}" return response 步骤4:语音合成输出 def text_to_speech(self, response): 调用TTS服务将文本转为语音 print(f"[语音输出] {response}") return response 完整交互入口 def chat(self, user_query): print(f"[用户输入] {user_query}") 1. 意图识别与实体抽取 intent, entities = self.extract_intent_and_entities(user_query) 2. RAG检索 context = self.retrieve_context(intent, entities) 3. LLM生成回答 response = self.generate_response(user_query, context) 4. 语音输出 self.text_to_speech(response) return response 模拟一次对话 agent = MetroAIAgent() agent.chat("15号线几点首班?")

关键步骤解析:

语音识别:乘客的语音先转换为文本,系统需要适配地铁嘈杂环境-1。

意图识别:判断乘客是想查时刻表、票价还是路线规划。

RAG检索:从知识库中精确获取相关信息。

LLM生成:大模型组织语言、润色表达。

跨系统联动:系统需要与清分系统(AFC Clearing System)、线网云大数据平台实时同步票卡数据,确保业务准确性-1。

七、底层原理/技术支撑

西安地铁AI助手的核心底层依赖以下关键技术:

7.1 向量数据库(Vector Database)

RAG检索的核心是将知识库中的文档转换为向量表示。常用的向量数据库包括Milvus、Pinecone、Qdrant等。当用户提问时,系统将问题同样向量化,然后进行近似最近邻(Approximate Nearest Neighbor, ANN) ,找到最相关的知识片段。

7.2 语音识别与合成(ASR/TTS)

地铁环境嘈杂,需要高鲁棒性的语音识别模型。系统支持中英文及部分方言输入,背后依赖端到端语音识别模型(如Whisper、Paraformer等)和语音合成模型-1。

7.3 意图识别与实体抽取(NLU)

基于BERT、RoBERTa等预训练模型进行微调,实现多轮对话中的上下文理解和意图跟踪。

7.4 跨系统数据同步

系统需要与清分系统(ACC/ACLC)、线网云大数据平台实时打通,实现“感知-分析-响应-服务”一体化-1。这一层的核心技术包括消息队列、微服务架构和分布式事务处理。

💡 篇幅所限,本文不做源码级深入剖析。后续文章将分别深入讲解:RAG检索的向量化原理、语音识别的工程实现、跨系统数据同步架构设计等,敬请期待。

八、高频面试题与参考答案

面试题1:大模型和RAG有什么区别?什么场景下选择RAG而不是微调?

参考答案:

区别:大模型是一个独立的生成式模型,RAG是一种结合检索与生成的架构模式。纯大模型的回答完全依赖其训练数据,而RAG允许在回答时动态检索外部知识库。

选择依据:当知识需要频繁更新(如地铁时刻表)、或者需要引入大量特定领域知识时,选择RAG更合适;当需要模型学习特定的回复风格或行为模式时,选择微调(Fine-Tuning)更合适。

关键踩分点:说出“时效性”、“知识库可控”、“训练成本”三个维度。

面试题2:AI客服系统中,RAG的检索召回率如何保证?

参考答案:

多路召回策略:结合向量检索(语义相似度)和关键词检索(BM25算法),提高召回覆盖面。

Query改写:将用户口语化问题改写为更规范的查询语句。

混合排序:使用Reranker模型对初召回结果进行精细排序,将最相关的片段排在前面。

知识库质量:结构化与非结构化数据的合理组织,元数据标注质量直接影响检索效果。

面试题3:如何解决大模型生成内容“幻觉”(Hallucination)问题?

参考答案:

RAG约束生成:强制模型回答必须基于检索到的文档,而非自己的“记忆”。可以在Prompt中明确要求“仅根据以下参考信息回答”。

低温度采样:在解码时设置较低的temperature参数(如0.1~0.3),减少随机性。

事实核查:生成后进行验证,检查回答内容是否在检索到的文档中有依据。

人工兜底机制:西安地铁AI助手中设置了“AI自主处理+人工招援”的服务闭环,当置信度不足时转人工处理-1。

面试题4:AI客服系统如何处理多轮对话中的上下文?

参考答案:

对话历史编码:将前几轮对话拼接成上下文窗口输入模型。

指代消解:识别“它”、“那里”等指代词的指代对象。

槽位填充机制:在多轮对话中逐步收集所需信息(如从“查票”到“从哪到哪”到“什么时候”),维护对话状态(Dialogue State)。

上下文窗口管理:使用滑动窗口策略保留最近N轮对话,避免超出模型上下文长度限制。

面试题5:西安地铁AI助手采用了哪些技术手段来适配地铁嘈杂环境?

参考答案:

多麦阵列麦克风:通过波束成形技术定向拾取用户声音,抑制背景噪声-17。

语音增强算法:采用降噪、回声消除等技术处理原始音频。

多模态输入:同时支持语音和文字输入,用户可根据环境选择-1。

方言适配:支持中英文及部分方言识别,扩大语音识别的适用人群-1。

九、结尾总结

本文围绕西安地铁AI助手这一真实案例,系统梳理了以下核心知识点:

| 知识点 | 关键结论 |

|---|---|

| 痛点认知 | 传统菜单式客服存在交互僵化、更新滞后、人力成本高等问题 |

| 大模型 vs RAG | 大模型是“大脑”(理解+生成),RAG是“引擎”(检索+赋能) |

| 核心架构 | 语音输入→ASR转写→意图识别→RAG检索→LLM生成→TTS输出 |

| 底层支撑 | 向量数据库、语音识别、NLU模型、跨系统数据同步 |

| 关键技术决策 | 选择RAG而非微调的核心依据:知识更新频率和领域广度 |

学习建议:初学者容易混淆大模型和RAG的概念,建议先理解“大模型本身有知识边界”这一前提,再理解“RAG是在外部知识库中查找答案”。面试中重点掌握RAG与微调的适用场景对比,以及幻觉问题的解决方案。

下一篇文章将深入讲解RAG检索系统的向量化原理与工程实现,包括Embedding模型选型、向量数据库对比、多路召回策略等进阶内容,欢迎持续关注。

本文数据来源:新华网、城市轨道交通网、西安日报、华商网等公开报道,发布时间为2025年12月至2026年2月-2-1-3。